开yun体育网在奇迹器资本高企、资源不竭趋紧的布景下-开云集团「中国」Kaiyun·官方网站

连年来,受半导体供应链弥留、中枢芯片产能受限以及海外地缘政事波动影响,奇迹器硬件价钱执续大幅高潮。尤其是企业数据系统参加的数据型奇迹器,受内存和存储的执续大幅加价影响,高潮幅度致使最初了 200%,况且委用周期延长,企业 IT 基础要领参加压力空前。

在此布景下,传统“以资源换性能”的轻视式膨胀模式已难执续。无数企业发现,即便无间增购奇迹器,系统资源欺诈率却永恒偏低,广大存在 CPU 欺诈率不及 20%、存储空间严重蹧跶等气象。股东的采购资本、电力花消与运维阻抑包袱,正在挤压企业利润空间。

面对资本与资源的双重不竭,单纯依赖硬件参加已不行执续。企业需转向“深耕易耨”的资源阻抑念念路,通过架构优化、时间升级和软件更正,栽植单元资源的产出服从。尤其在数据库层面,算作系统中枢与资源花消大户,其架构先进性奏凯决定奇迹器使用规模。

因此,继承什么样的数据库家具,能力从泉源减少硬件依赖,助力企业降本增效、扫尾绿色可执续发展?本文将重心探讨。

1 数据库架构选用正严重影响硬件资本

数据库算作企业信息系统的中枢,其架构设想奏凯决定了奇迹器资源的使用服从。在硬件资本执续攀升的布景下,融会数据库架构与资源花消之间的内在关联,成为优化 IT 参加的关键。以下五个方面与“省资源”密切辩论:

资源欺诈率:资源欺诈率是预计奇迹器 CPU、内存、磁盘和网罗等资源被有用使用进程的中枢看法。传统数据库常因架构僵化、静态分拨导致资源“空转”或“争抢”。而当代散播式数据库通过动态调度与负载平衡机制,扫尾资源的按需分拨,权臣栽植举座欺诈率,减少奇迹器节点数目。

I/O 服从:I/O 性能是影响数据库反应速率与系统负载的关键要素。低效的读写操作会加重磁盘走访频率,增多 CPU 恭候时间,导致奇迹器资源蹧跶。继承 LSM-Tree 结构、写优化存储引擎和智能缓存机制,可大幅数落 I/O 放大,栽植单元资源处理能力。

数据压缩比:数据压缩时间奏凯影响存储资源花消。高压缩比意味着疏通数据占用更少的磁盘空间和内存缓存,进而数落存储资本与 I/O 压力。OceanBase 等新式数据库通过列式存储、编码优化和自研压缩算法,在保险查询性能的同期扫尾高达 5:1 致使更高的压缩比,权臣知人善任存储资源。

多田户梗阻与资源分享机制:多田户架构允好多个业务分享归拢套数据库实例,通过资源池化与逻辑梗阻,在保险安全与性能的前提下扫尾资源复用。比拟为每个业务单独部署数据库,该机制大幅减少奇迹器数目,栽植资源欺诈率,数落总体领有资本(TCO)。

弹性伸缩能力:弹性伸缩能力使数据库能凭据业务负载动态调节资源规模。在流量低谷时自动缩容,开释闲置奇迹器;在岑岭时快速扩容,幸免性能瓶颈。这种“按需使用”的模式,幸免了传统“预留冗余”带来的资源蹧跶,扫尾信得过的经济诡计。

数据库架构的先进性奏凯决定了奇迹器资源的使用服从。通过优化上述五个方面,企业可在不增多硬件参加的前提下,权臣栽植系统承载能力,扫尾绿色、节能、高效运营。

2 传统分库分表 vs 原生散播式,硬件资本畛域 60%?

在现时企业 IT 系统日益复杂的布景下,传统分库分表架构的散播式数据库虽在扩展性与高可用方面得回发扬,但其在奇迹器资源欺诈服从上的短板愈发突显。

开端,架构复杂、组件繁密是广大问题。好多传统散播式数据库由多个沉寂模块组成,如诡计节点、存储节点、元数据奇迹、监控系统、备份组件等,需部署在无数奇迹器上,导致硬件资源分散、阻抑支出大,且各组件间通讯每每,增多了网罗负载与蔓延,进一步数落了举座服从。

其次,资源欺诈率不平衡气象严重。传统架构往往继承静态资源分拨模式,难以凭据业务负载动态调节。在业务低谷期,无数奇迹器处于闲置或低负载情状,形成动力与投资的蹧跶;而在岑岭期,又因扩展粒度轻视,不得不举座扩容,带来资本激增。此外,数据冗余度高,副本机制不够天真,当年需守护 3 副本致使更多,占用无数存储空间与内存资源。

更为关键的是,紧耦合的单格局设想使得系统天真性差,故障梗阻能力弱,一朝局部极度,易激励四百四病,影响举座清楚性,进而迫使企业参加更多奇迹用具于容灾与备份,进一步推高资源花消。

以金融中枢的“两地三中心”架构为例,如数据存储为 5 副本,举座数据 4 个分片,只筹商坐褥集群情况下,不同类型的数据库所使用的奇迹器节点数,如下表所示,传统分库分表架构需要的奇迹器数目比原生散播式架构多出 60%。

不仅如斯,如若是传统分库分表架构,可能还需要构建一套后置的积累业务数据库,还需要迥殊的奇迹器和存储资源。

3 OceanBase 的降本奉行

原生散播式数据库 OceanBase 以“省资源”为中枢念念路进行更正,在奇迹器资本高企、资源不竭趋紧的布景下,通过精简组件、高压缩、多田户分享与一体化架构的协同作用,构建了从架构层到数据层的全栈资源优化体系,成为搪塞奇迹器资本高企、扫尾绿色诡计与可执续发展的关键时间旅途。

散播式架构 + Paxos 条约:精简组件,以高效架构数落硬件依赖

OceanBase 的散播式设想不仅保险了系统的高可用性,更通过架构精简与机制优化,权臣数落了对奇迹器数目和硬件资源的依赖。与传统分库分表散播式数据库动辄依赖数十个组件(如沉寂的元数据奇迹、日记奇迹、监控模块等)不同,OceanBase 继承一体化交融架构,将诡计、存储、日记、事务阻抑等中枢功能高度集成于和洽的节点中,大幅减少外部依赖和组件数目,从而数落部署复杂度与奇迹器支出。

在数据复制机制上,OceanBase 基于 Paxos 条约扫尾多副本一致性,况且引入举例 2F1A 架构(即两个完好数据副本 + 一个仲裁奇迹)的天真部署模式。该架构下,仅需三个节点即可扫尾机房内大约跨机房的高可用,其中两个节点存储完好数据,第三个节点仅同步部分高可用辩论信息而不存储全量数据和日记。这既保证了系统在职意单点故障下仍能自动切换、不丢数据(RPO=0),又幸免了第三个节点的存储和诡计、网罗资源的蹧跶。

比拟传统“三副本全量复制”带来的 200% 存储冗余,2F1A 架构将迥殊存储支出数落至约 100%,奏凯减少 1/3 的奇迹器存储需求。同期,由于组件少、部署圣洁,整个这个词集群的网罗通讯、运维阻抑与监控包袱也权臣下落,进一步开释 CPU 与内存资源,栽植了单元奇迹器的承载能力。

这种“精组件、轻部署、低冗余”的设想理念,使 OceanBase 在保险金融级高可用的同期,极大缓解了企业对奇迹器采购和机房空间的压力,信得过扫尾了高可用与低资本的平衡,为资源受限场景下的数据库部署提供了高效、求实的措置决议。

数据散播与负载平衡:扫尾资源均享,幸免“忙闲不均”

在大规模散播式数据库系统中,奇迹器资源的欺诈服从不仅取决于单机性能,更依赖于举座集群的数据散播与负载调度能力。施行中,常出现“部分奇迹器高负载运行、接近瓶颈,而另一些奇迹器却永恒闲置”的“忙闲不均”气象,这不仅蹧跶硬件投资,还可能激励性能瓶颈与系统风险。

OceanBase 通过自动分片(Sharding)、热门搬动与副本平衡机制三大中枢时间,构建了智能、动态的负载平衡体系,有用幸免资源歪斜,扫尾集群举座资源的高效、平衡欺诈。

自动分片(Sharding):从泉源突破数据辘集

传统数据库常继承手动分库分表策略,数据分歧依赖东谈主工预判,极易因业务增长不均导致某些分片成为“热门”,而其他分片资源闲置。OceanBase 继承基于一致性哈希与范围分区结合的自动分片机制,可将大表数据动态拆分为多个“数据片(Partition)”,并均匀散播到不同奇迹器节点上。系统凭据数据主键或分区键自动路由读写央求,确保数据写入和查询负载在集群中平庸分散。同期,分片粒度细(可达到 GB 级),支执动态增减,幸免了“大块数据辘集存放”带来的局部压力。这种自动化、邃密化的分片策略,从数据布局的泉源就辞谢了奇迹器负载的极点不均。

热门搬动:动态反应负载变化,智能“削峰填谷”

即使着手散播均匀,业务走访模式的变化仍可能激励“热门”——某些数据片因高频走访导致方位奇迹器 CPU、I/O 资源耗尽。OceanBase 具备及时负载监控与热门识别能力,可自动检测到走访频率极度的数据片。一朝发现热门,系统将触发烧点搬动机制,将高负载的数据片动态搬动到负载较低的节点上,并同步更新路由信息。

整个这个词过程对应用透明,无需停机或东谈主工干扰。举例,在电商大促期间,某个热门商品的订单表可能出现走访激增,系统会自动将其辩论数据片搬动至优游奇迹器,幸免原节点过载崩溃,同期激活闲置资源,扫尾“削峰填谷”。这种动态调度能力,使集群能自顺应业务波动,最大化欺诈每一台奇迹器的处理能力,幸免“少数机器拚命跑,多数机器晒太阳”的资源蹧跶。

副本平衡机制:辞谢“冷副本”占用资源却无孝顺

在散播式系统中,数据当年以多副本景观存在以保险高可用。但是,若副本散播不均,可能出现“主副本辘集于少数节点”或“从副本永恒不参与读奇迹”的情况,导致资源欺诈不充分。OceanBase 通过副本平衡机制,扫尾副本在集群中的智能散播与角颜色度。系统支执多种副本类型(如全功能副本、日记副本、只读副本),并凭据负载情况动态调节其散播。举例,在读密集场景下,系统可自动将只读副本部署到负载较低的节点,并诱骗读央求分流,栽植举座糊涂。同期,通过副本自动搬动与再平衡,确保在节点扩容、缩喜悦故障后,数据副本仍能均匀散播,幸免新节点空载或旧节点过载。

自动分片、热门搬动与副本平衡机制,组成了 OceanBase 扫尾资源高效欺诈的“三驾马车”。它们协同作用,使数据库集群不再是静态的“机器堆叠”,而是一个具备自我感知、自我鬈曲能力的智能体。无论是搪塞突发流量、业务增长,已经硬件变更,系统齐能动态优化数据散播,确保莫得一台奇迹器被过度压榨,也莫得一台被永恒闲置。这种“均享资源、协同承载”的理念,恰是当代数据库在奇迹器资本飞扬布景下扫尾“省资源、高可用、强扩展”的关键方位。

高压缩能力:从存储层“瘦身”奇迹器需求

OceanBase 内置多级压缩机制,结合列式存储、编码优化与自研压缩算法,在不就义性能的前提下扫尾高压缩比。举例,对文本、数字等类型数据继承字典编码、行程编码等,再叠加 ZSTD 或 LZ4 压缩,平均压缩比当年在 3:1 到 5:1 之间。这意味着正本需要 4 台奇迹器存储的数据,现仅需 1 台即可承载,奏凯减少存储奇迹器采购与电力花消,权臣数落总体领有资本(TCO)。

多田户架构:资源分享栽植 CPU 与内存欺诈率

OceanBase 支执大集群多田户模式,允好多个业务系统分享归拢套集群资源。通过资源池化、逻辑梗阻与配额阻抑,扫尾 CPU、内存、I/O 的细粒度分拨与动态调度。比拟传统“一应用一数据库”的孤岛式部署,多田户模式幸免了资源碎屑化与空置蹧跶。在业务负载错峰时,系统可自动将优游资源调度给高负载田户,举座资源欺诈率从传统架构的 20%-30% 栽植至 60% 以上,权臣减少奇迹器总参加。

一体化架构:突破 OLTP 与 OLAP 割裂,交融向量与标量数据阻抑,全面数落硬件需求

OceanBase 的一体化 HTAP(Hybrid Transactional/Analytical Processing)架构,从根底上重构了传统分库分表的散播式数据库“事务与分析分离”的固有模式,扫尾了在归拢引擎内同期支执高并发事务处理(OLTP)与复杂实期间析(OLAP)。这一架构不仅幸免了数据在不同系统间每每搬运带来的蔓延与资源蹧跶,更通过向量与标量数据的一体化阻抑,在 AI 期间进一步开释资源后劲,权臣数落企业对奇迹器硬件的总体需求。

传统架构中,OLTP 系统庄重业务交游,数据需通过 ETL 经过异步同步至数据仓库或大数据平台进行分析,导致系统间存在多套数据副本、重叠存储与诡计资源参加。而 OceanBase 通过和洽存储引擎与分享数据视图,使分析查询可奏凯走访最新事务数据,无需迥殊复制,从泉源上阻绝了数据冗余与资源重叠参加。这不仅知人善任了用于数据同步的中间件奇迹器(如 Kafka、Flink 集群),也减少了数据仓库专用节点的部署规模。

更迫切的是,跟着东谈主工智能与大模子应用的普及,企业濒临海量向量数据(如用户画像、商品特征、语义镶嵌)与传统标量数据(如订单、账户、交纪行载)并存的搀杂负载场景。传统决议往往需要分别构建关联型数据库与向量数据库,导致系统割裂、数据孤岛、运维复杂,且需双倍奇迹器资源复旧。OceanBase 前瞻性地支执向量与标量数据的和洽存储与网络查询,在归拢集群内扫尾:

和洽索引机制:支执 B+ 树、哈希、HNSW 等多种索引类型,针对标量与向量数据分别优化,栽植查询服从。

搀杂负载调度:通过资源梗阻与优先级戒指,保险高并发事务与大规模向量检索互不干扰。

网络分析能力:支执 SQL+ 向量一样度搜索的交融查询,举例“查找与该用户向量一样的高价值客户,并统计其交游行为”,扫尾 AI 驱动的及时智能决策。

这种一体化阻抑花样,使企业无需迥殊采购向量数据库专用奇迹器,也幸免了数据跨系统同步的带宽与诡计支出。在某大型电商平台的奉行中,通过 OceanBase 和洽阻抑用户行为标量数据与保举模子生成的向量特征,奇迹器资源总量减少 45%,同期查询反应速率栽植 30%。

在 AI 与事务深度交融的今天,OceanBase 的一体化架构将匡助企业高出传统“省资源”的领域,迈向“智能资源协同”的新阶段。不仅不错吊销 OLTP 与 OLAP 之间的资源壁垒,更不错买通结构化数据与非结构化向量数据的畛域,信得过扫尾“一套系统、一种存储、多种负载”,为企业在 AI 期间数落硬件参加、栽植资源服从提供坚实底座。

4 典型降本案例

河北出动中枢酬报库系统硬件降本超 60%

河北出动的酬报库系统是其 B 域中枢业务系统之一,主要面向数万家渠谈商、代理商等诱骗伙伴,凭据其销售出动家具(如号卡、套餐、末端等)的功绩,按动态规则诡计并披发酬报。举座升级至 OceanBase 原生散播式数据库后,部署于国产 ARM 奇迹器与 Bclinux for Euler 操作系统,扫尾从芯片到数据库的全栈国产。

奇迹器资源占用大幅数落

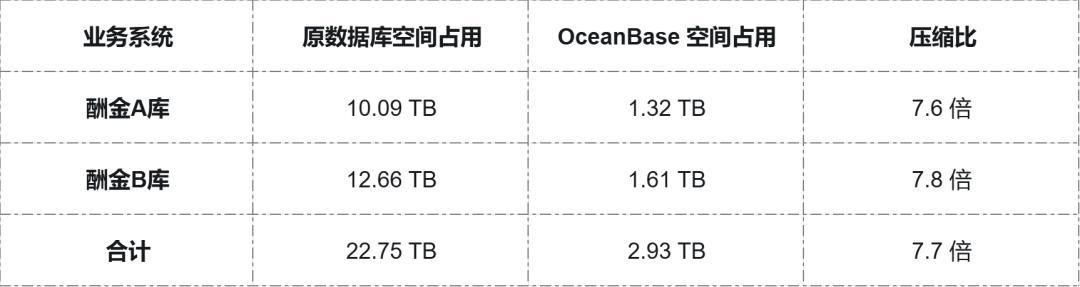

存储资源:

原系统数据量:22.7 TB;

OceanBase 存储量(含三副本):2.9 TB;

存储压缩比达 7.8 倍,逻辑数据量仅约 0.97 TB;

获利于 LSM-Tree 架构与高效压缩算法。

诡计资源:

月结岑岭期间,主机 CPU 峰值使用率清楚在 60% 以下(原系统>90%);

资源欺诈更平衡,具备弥漫余量搪塞改日业务增长。

资本知人善任权臣

硬件、存储、运维及灾备等多个维度扫尾全面降本,其中备份体系的优化成为资本与服从双栽植的关键亮点:

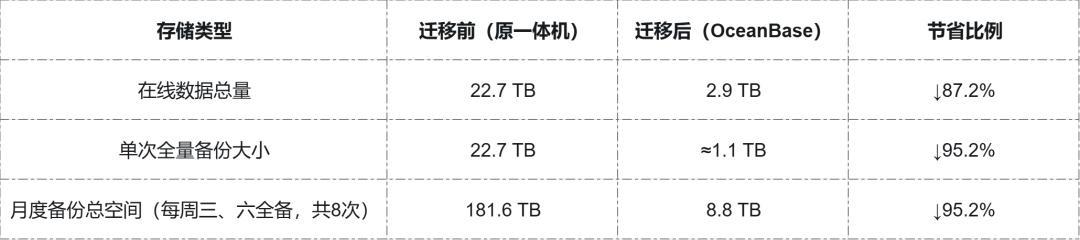

(1)存储与备份资本大幅下落

下表为搬动前后存储空间使用对比:

(2)还原服从栽植带来隐性资本知人善任

原系统全库归附需 12–24 小时;

OceanBase 还原时间镌汰至 2–4 小时;

还原时间知人善任 80%–90%,权臣数落业务中断风险与济急资本。

(3)其他资本优化

硬件资本下落超 60%:通用 ARM 奇迹器替代不菲一体机;

运维资本数落约 50%:通过 OceanBase 单集群多田户能力,A/B 库和洽托管;

应用改形资本近乎为零:Oracle 兼容模式支执率达 99.9% 以上。

系统性能全面栽植

月结服从栽植 5 倍:

原耗时:2880 分钟(48 小时);

搬动后:549 分钟(约 9.15 小时);

HTAP 交融加快分析:复杂多维查询从分钟级降至秒级;

高可用保险:继承 3-3-3 多副本部署,RPO=0,RTO<30 秒。

南京银行 60 余套关键业务系统奇迹器从 100 台数落至 18 台

从 2017 年于今,南京银行多个迫切业务系统基于 OceanBase 投产,包括互联网中枢、数字信用卡、ECIF、金钱平台、个东谈主待业金、手机银行等。在进行数据库升级的同期,行内也诡计对系统资源进行整合。

现时架构基本是一套应用一个数据库实例,部分迫切系统使用 Oracle RAC,多个系统的资源无法分享,部分数据库奇迹器使用率永恒在 20% 以下,又有部分永恒在 80% 操纵,资源使用相配不平衡。总体霸术两套 OceanBase 数据库集群,按业务系统迫切性和关联性分类。

使用 OceanBase 多田户的特色,将多台数据库奇迹器构建为资源池的景观,每个传统数据库实例对应一个 OceanBase Oracle 兼容模式田户,完成 60 余套数据库资源整合。戒指 2025 年四季度,已有 60 余套传统数据库平滑升级至这两套 OceanBase 数据库集群。奉行服从如下:

知人善任存储资本:60 余套 Oracle 数据库总存储空间占用数十 TB,搬动到 OceanBase 后约 10 TB,知人善任存储空间最初 60%。

减少硬件参加:原 60 余套数据库使用了近 100 台奇迹器,包括微型机、x86、臆造化平台等,搬动到 18 台国产奇迹器构建的两套 OceanBase 数据库集群。且奇迹器除外,本次搬动还减少了辘集式存储、存储交换机等物理确立的使用,总体资本数落 60%。

架构更先进:从原有的双机房东备架构升级到三机房架构,扫尾了机房级别双活,且容灾级别更高,机房级故障可作念到 RPO=0/RTO<8 秒;新架构扫尾了数据库资源池化,水平扩展更天真方便。

5 来自 Forrest 的认证:OceanBase 越用越低廉

凭据 Forrester Consulting 发布的《OceanBase 总体经济影响领悟 (Total Economic ImpactTM) 领悟》败露, 在投资使用 OceanBase 数据库后,受访者方位的企业不错牢固搪塞业务峰值,有用复旧业务增长,并数落数据库的资源资本。

以其中某机构为例,该机构是一家领有千万级别用户,资产规模达 1000 亿东谈主民币以上的金融机构。在使用 OceanBase 数据库之前,受访者默示其企业由于业务快速发展,数据量激增,原少见据库在性能上已无法复旧业务的正常运行,况且原少见据库的资本高企,企业压力突显。

使用 OceanBase 后数据存储空间压缩至原来的 1/4 至 1/3;同期由于继承集群式的资源分拨花样,奇迹器的使用服从得到栽植。数据存储压缩能力与数据库资源使用服从的栽植共同带来了奇迹器资本,以及进一步的机位、机房、动力等资本的权臣数落。

此外,OceanBase 的数据压缩能 力与资源分拨花样极大数落了企业关于数据库奇迹器的需求,从而数落了与奇迹器运行相对应的电力资本,以权臣的动力知人善任支执企业环境、社会与治理 (ESG) 举措,并践行国度碳达峰与碳中庸的计谋。

经测算,该组织切换至 OceanBase 数据库后开yun体育网,第一年平均 每注册用户的数据库资本较切换之前数落 53.9%,第二 年、第三年数落比例分别为 54.5% 与 54.7%,跟着业务量的上升,单用户数据库资本呈现无间数落的趋势。

- 上一篇:欧洲杯体育好意思国在中东的军事当作对法国的安全产生了影响-开云集团「中国」Kaiyun·官方网站

- 下一篇:没有了